Искусственный интеллект научили материться с благими целями, и он заговорил лаконично

Российские ученые нашли связь между обсценной лексикой и лаконичностью выражения мыслей и применили её для обучения нейросетей

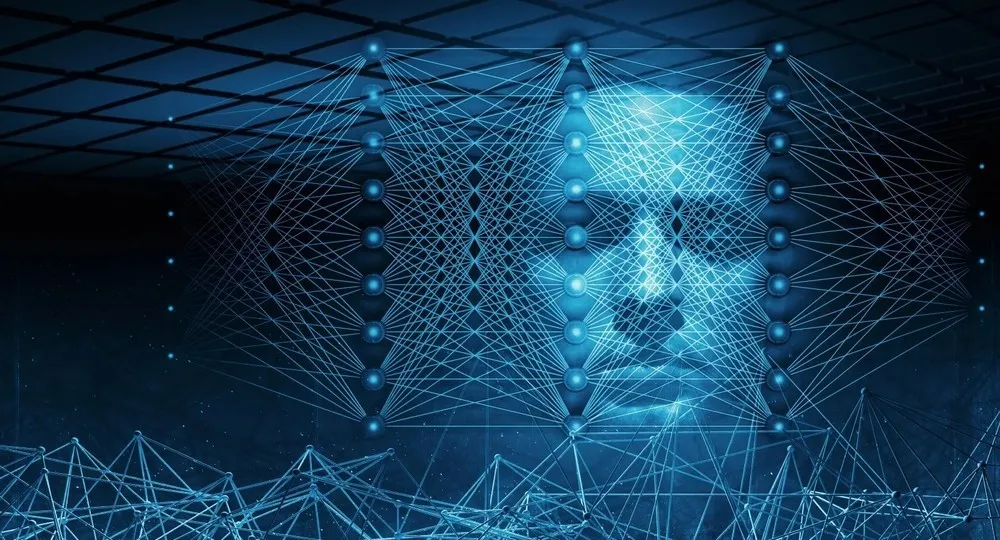

Учёные из Института AIRI, Высшей школы экономики и Университета Иннополис выяснили, что модели искусственного интеллекта могут использовать особенности нецензурной лексики для более компактного представления смысла текста.

Исследование показало, что в естественной речи одно грубое слово часто заменяет целое предложение, кратко и ёмко передавая его смысл, и такую «смысловую плотность» можно использовать для оптимизации обработки текстов большими языковыми моделями (БЯМ).

Кратко и ёмко

По словам авторов, идея проекта заключалась не в том, чтобы научить ИИ ругаться, а в том, чтобы дать нейросети инструмент для экономии вычислительных ресурсов за счёт сокращения объёма текста без заметной потери информативности.

В ходе экспериментов учёные проверяли, как модели работают с русскоязычными текстами разной длины, начиная от коротких фраз до полноформатных новостных материалов, и отметили, что использование семантической функции обсценной лексики помогает эффективно сжимать контент.

Смысловая плотность

Они подчёркивают, что рабочая версия модели в обычных сценариях не использует грубые выражения напрямую при обработке текста, а извлекает пользу из анализа контраста между нейтральной и более «ёмкой» формой выражения.

Это особенно актуально теперь, потому что объёмы данных постоянно растут, и вычислительные мощности не всегда за ними успевают. Использование лаконичных речевых конструкций позволяют снизить нагрузку на системы обработки информации и ускорить работу алгоритмов без ущерба для глубины её понимания.