Искусственный интеллект в медиа: как оправдать доверие?

Искусственный интеллект все глубже внедряется в сферу медиа — от генерации контента до модерации и персонализации новостных лент. Новые инструменты позволяют быстрее решать поставленные задачи. Казалось бы, от этого только польза. Но ИИ создает как новые возможности, так и риски, связанные с этикой и использованием новых технологий в преступных целях. Россия поднимает вопрос этики ИИ на международном уровне и выступает за защиту гуманитарных принципов в цифровую эпоху.

Машина ни за что не отвечает

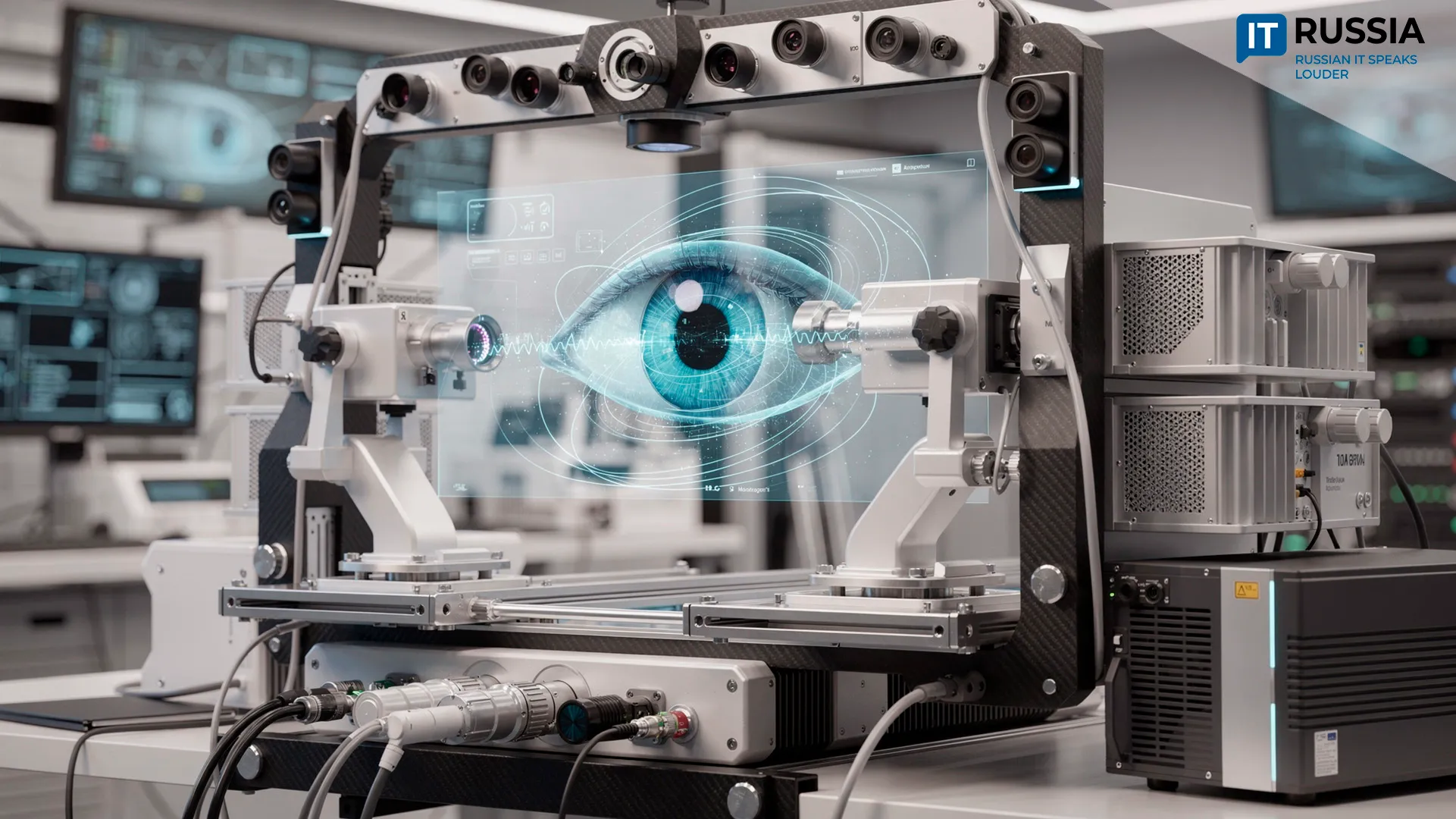

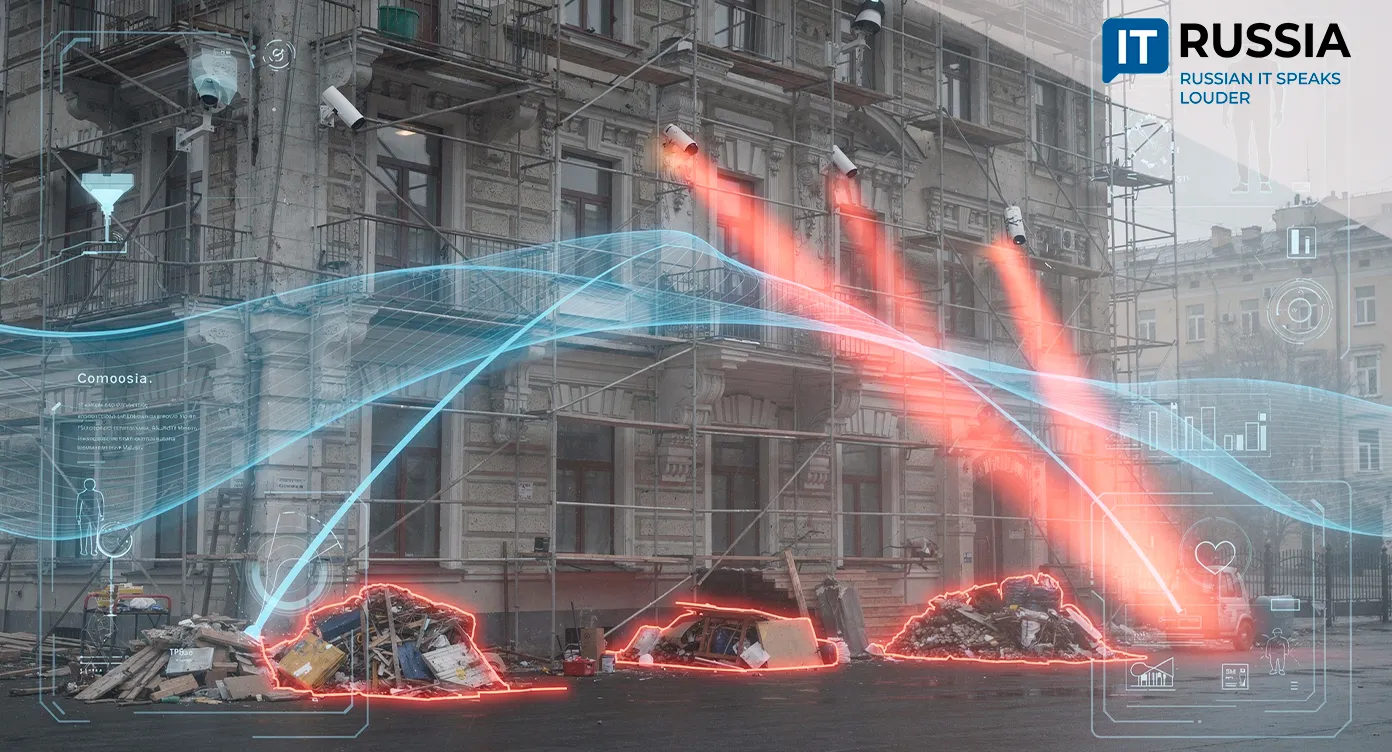

В сфере медиа искусственный интеллект используют для автоматического написания новостей, создания иллюстраций, видеомонтажа и озвучки. Многие российские редакции успешно применяют ИИ, избавляя сотрудников от рутинной работы. Но, все, что так удобно, имеет и негативные последствия. Некоторые эксперты полагают, что использование нейросетей лишает человека критического мышления. Все это может привести к тому, что человеку будет сложно отличить правду от вымысла, реальное от виртуального.

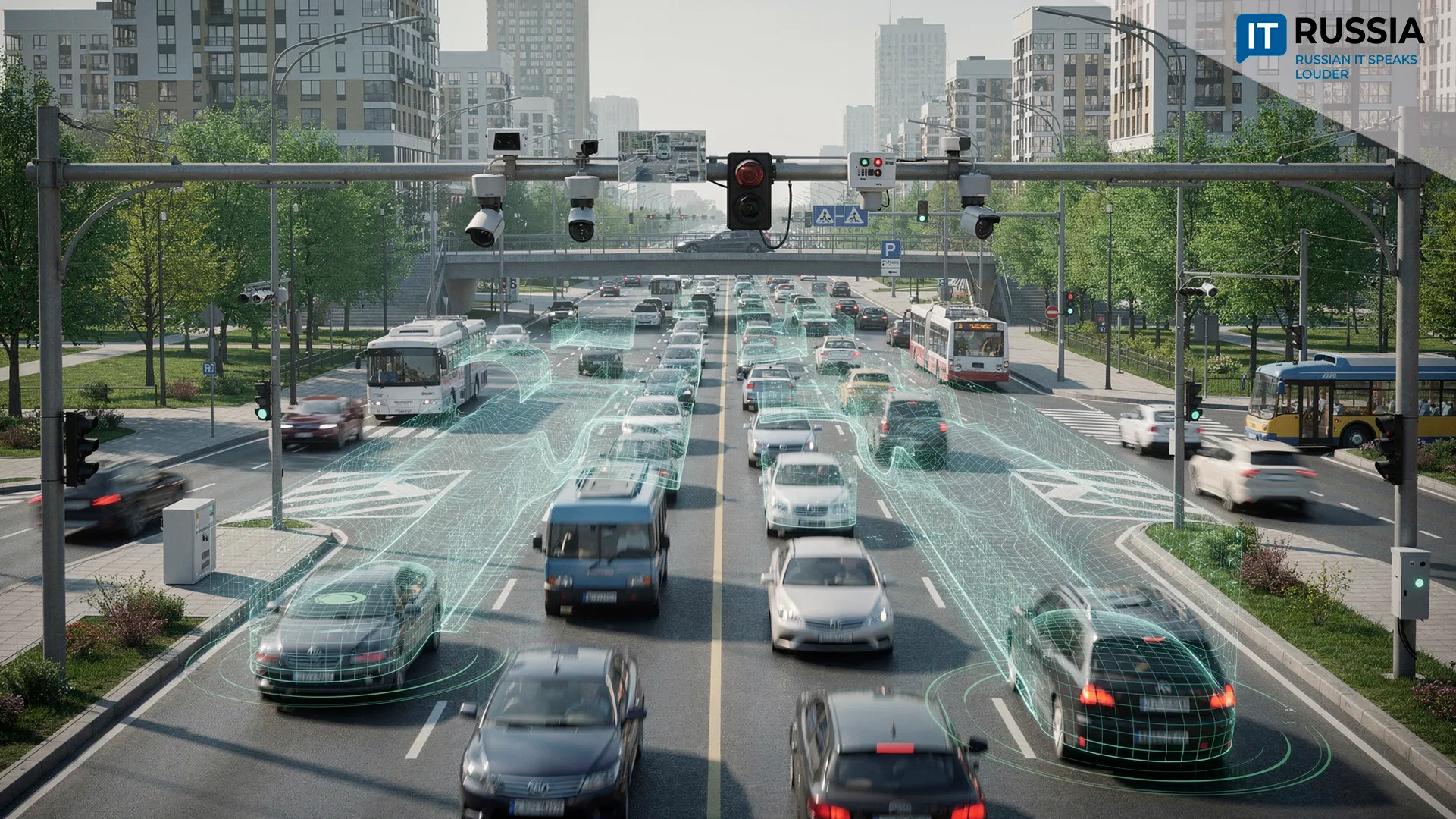

Машинные алгоритмы персонализируют новостную повестку. Удобно? Конечно, зачем читать про рыбалку, если вы не рыбак... Но также персонализация ведет к эффекту «информационного пузыря», а в перспективе под угрозой может оказаться общественная дискуссия.

Еще бОльшие риски связаны с тем, что ИИ можно использовать для создания ложного контента и намеренного обмана людей. В наше время все чаще возникают вопросы, связанные с соблюдением авторских прав, прозрачности источников, подмены фактов. И, наконец, вопрос: кто же будет нести ответственность за сгенерированный контент?

Россия настаивает на этическом регулировании ИИ

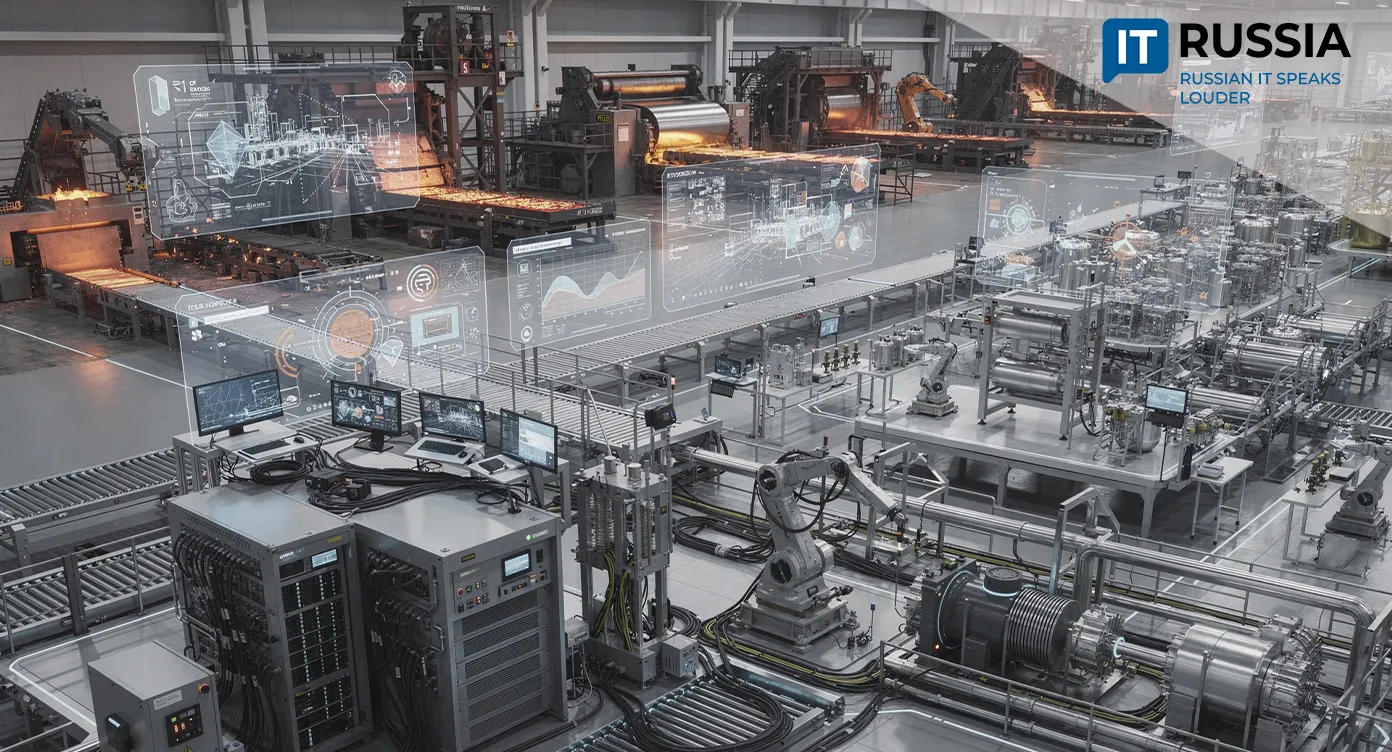

В нашей стране особое внимание уделяется применению ИИ в СМИ. Россия поднимает вопрос о необходимости общих международных норм по этике медиатехнологий на базе ИИ. В октябре 2021 года на площадке международного форума, посвященного проблемам использования искусственного интеллекта, был принят Кодекс этики в сфере ИИ. Документ подписан крупнейшими российскими компаниями, но носит рекомендательный характер. В 2023 году к соглашению присоединились компании еще 10 стран Африканского континента.

Как обеспечить информационную безопасность?

Справиться с риском можно только, если включить инструменты контроля над машинными алгоритмами. Также эксперты выступают за обязательное информирование аудитории о взаимодействии с искусственным интеллектом. Они настаивают на запрете на передачу полномочий искусственному интеллекту в вопросах нравственного выбора при подготовке медиаконтента и определение круга потенциальных тем, для работы над которыми использование ИИ неприемлемо по этическим соображениям.

Ответственность за последствия работы систем искусственного интеллекта должны нести как пользователь, так и разработчик. Поэтому в редакциях российских медиахолдингов разрабатываются собственные рекомендации по применению ИИ, включая «человеческий контроль», обязательную маркировку и защиту прав автора.