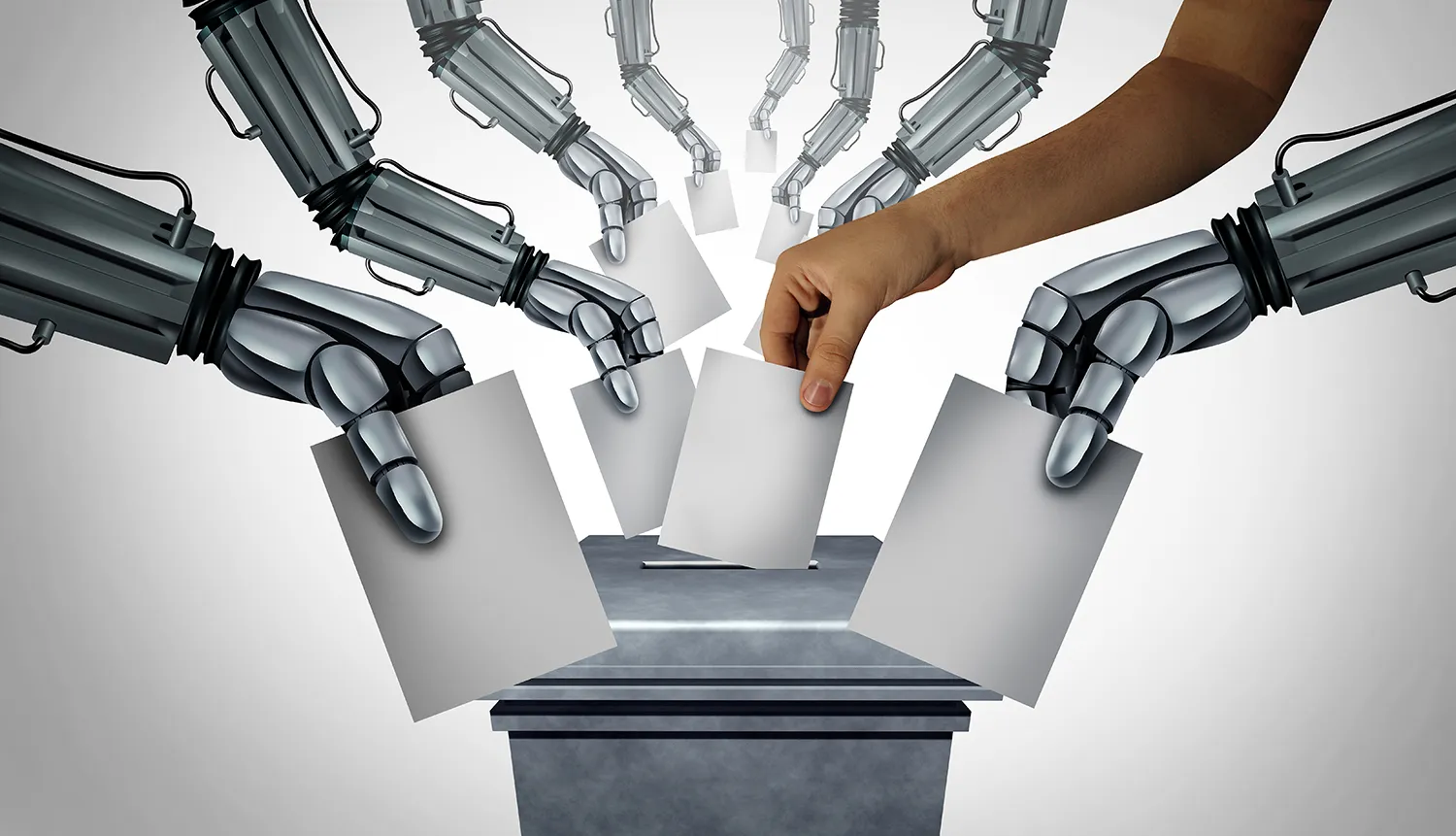

В Госдуме предложили маркировать ИИ-контент в агитации

В России предложили маркировать предвыборные материалы, сгенерированные ИИ. По мнению автора инициативы, избиратели должны быть защищены от возможных фейков.

Избиратель должен знать об ИИ

В Госдуме предложили маркировать агитационные материалы, созданные путём ИИ-генерации, в том числе и с помощью нейросетей. С такой инициативой выступил первый зампред комитета по информационной политике Антон Горелкин. По его мнению, избиратели должны знать о том, что тот или иной кандидат использует нейросети для генерации видеоконтента. В ЦИК разделяют позицию депутата, считая, что маркировка при этом должна быть хорошо заметной, чтобы избиратели точно увидели, что контент сгенерирован ИИ.

Предложенная идея представляется весьма своевременной. Несмотря на практически повсеместное внедрение ИИ-технологий, использование нейросетей в избирательном процессе до сих пор никак не регулируется законом. При этом риск создания дипфейков, подделки сообщений (в том числе официальных заявлений) и манипуляций существует. К этому приводит недостаток законодательного регулирования использования ИИ. Кроме того, есть и технические и юридические пробелы: кто и каким образом должен маркировать такой контент, как контролировать соблюдение данных норм и какова должна быть ответственность за их нарушение.

Вопросы, связанные с применением нейросети в избирательных процессах, затрагивают все население страны. К примеру, только в Едином дне голосования в 2025 году задействован 81 регион РФ – проводятся прямые выборы губернаторов, выборы депутатов законодательных собраний и другие избирательные процедуры.

Маркировка на экспорт

Некоторые разработки законопроектов и концепций маркировки ИИ-контента, как и маркировки дипфейков и синтетического контента, уже есть. Помимо этого, рассматривается закрепление самих терминов “искусственный интеллект”, “синтетический контент”, “дипфейк”. Что же касается предполагаемого применения новых норм, то, безусловно, маркировка должна быть заметной (нанесенной не мелким шрифтом), вероятно использование водяных и графических знаков. Необходимо также определить субъектов ответственности, создать систему надзора и контроля нарушений.

Вместе с тем необходимо проработать и возможные риски. К примеру, мошенники вряд ли будут маркировать свои материалы, поэтому само по себе нанесение маркировки может оказаться недостаточной мерой. Не исключено сопротивление новым нормам со стороны технологических компаний, СМИ, кандидатов – очевидно, что соблюдение закона повлечет за собой дополнительные затраты и технологические сложности, а также повлияет на оперативность.

К слову, в других странах работа над регулированием ИИ-контента уже ведется. Так, в ЕС принят закон об ИИ, в рамках которого есть в том числе требования прозрачности и маркировки контента. Поэтому российский опыт может оказаться хорошим экспортным предложением – особенно если законодательство будет ясным, хорошо реализуемым и содержать в себе эффективные технологии для обнаружения дипфейков.

Обсуждения в ветвях власти

Первые предложения, касающиеся маркировки ИИ-контента и разработки понятийного аппарата, появились еще в 2024 году – обсуждения на эту тему проходили тогда в Госдуме. С инициативами выступали как отдельные депутаты, так и представители Минцифры и Роскомнадзора.

В 2025 году с призывом к законодательному урегулированию применения ИИ в избирательной сфере выступила глава ЦИК Элла Памфилова. Она обратила особое внимание на риски фейков, которые будут влиять на общественное мнение. Также в Госдуме и федеральных органах власти обсуждается создание законов и концепций, регулирующих не только маркировку контента, но и обязательную ответственность за публикацию дипфейков без согласия. Вероятнее всего, часть предложений станет базой нового закона, но полного текста законопроекта пока нет.

Цифровизация выборов

Инициатива маркировки агитматериалов с ИИ представляется логичным шагом, учитывая общий контекст цифровизации и наличия рисков использования ИИ-технологий в политической сфере. Маркировка может стать эффективным инструментом для повышения прозрачности и доверия избирателей – при условии, что она будет понятной, хорошо видимой и подкрепленной механизмами контроля. Однако только введением маркировки текущие проблемы не решатся. Потребуются надежные средства защиты от манипуляций, технологические средства контроля, ответственность за нарушения закона.

Думается, в течение 1-2 лет можно ожидать либо принятия законопроекта, либо расширения нормативной базы. С большой долей вероятности за этот срок могут быть введены основные понятия и определения, сформированы требования к самой маркировке. В дальнейшем, скорее всего, уже появится практика судебных или административных санкций за нарушение. Не исключено и внедрение автоматических инструментов проверки и выяснения нарушений. В долгосрочной перспективе регулирование ИИ в предвыборной агитации станет частью более широкой системы ИИ-регуляций. В нее будут входить и ограничения на использование определенных видов ИИ-генерации.